Сеть глубоких убеждений - Deep belief network

| Часть серии по |

|

Машинное обучение и интеллектуальный анализ данных |

|---|

|

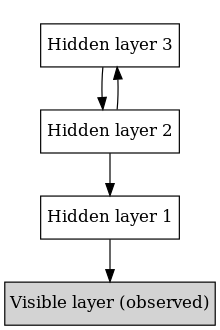

В машинном обучении , глубокое убеждение сеть ( ДБНО ) является порождающей графической моделью , или в качестве альтернативы класса глубокой нейронной сети , состоящий из нескольких слоев скрытых переменные ( «скрытые единиц»), со связями между слоями , но не между единицами в пределах каждый слой.

Обучившись на наборе примеров без присмотра , DBN может научиться вероятностно восстанавливать свои входные данные. Затем слои действуют как детекторы объектов . После этого шага обучения DBN может быть дополнительно обучен под наблюдением для выполнения классификации .

DBN можно рассматривать как состав простых неконтролируемых сетей, таких как ограниченные машины Больцмана (RBM) или автоэнкодеры , где скрытый слой каждой подсети служит видимым слоем для следующей. RBM - это неориентированная , основанная на генерации модель энергии с «видимым» входным слоем и скрытым слоем и связями между слоями, но не внутри них. Эта композиция приводит к быстрой, послойной неконтролируемой процедуре обучения, где контрастное расхождение применяется к каждой подсети по очереди, начиная с «самой нижней» пары слоев (самый низкий видимый слой является обучающим набором ).

Наблюдение за тем, что DBN можно жадно обучать , по одному уровню за раз, привело к одному из первых эффективных алгоритмов глубокого обучения . В целом, существует множество привлекательных реализаций и использования DBN в реальных приложениях и сценариях (например, электроэнцефалография , открытие лекарств ).

Обучение персонала

Метод обучения RBM, предложенный Джеффри Хинтоном для использования с обучающими моделями «Продукт эксперта», называется контрастной дивергенцией (CD). CD обеспечивает приближение к методу максимального правдоподобия , которое в идеале можно было бы применять для изучения весов. При обучении одного RBM обновления веса выполняются с градиентным спуском с помощью следующего уравнения:

где, - вероятность видимого вектора, равная . является статистической суммой (используется для нормализации) и является функцией энергии, присвоенной состоянию сети. Более низкая энергия указывает на то, что сеть находится в более «желательной» конфигурации. Градиент имеет простую форму, где представляют собой средние значения по распределению . Проблема возникает при выборке, поскольку для этого требуется расширенная переменная выборка Гиббса . Компакт-диск заменяет этот шаг запуском попеременной выборки Гиббса для шагов (значения производительности). После шагов выполняется выборка данных, и эта выборка используется вместо . Процедура CD работает следующим образом:

- Инициализируйте видимые единицы тренировочным вектором.

- Обновление скрытых блоков параллельно данные видимые блоки: . является функцией сигмовидной и является смещение .

- Обновление видимых блоков параллельно , учитывая скрытые блоки: . предвзятость . Это называется этапом «реконструкции».

- Повторно обновите скрытые блоки параллельно с учетом реконструированных видимых блоков, используя то же уравнение, что и на шаге 2.

- Выполните обновление веса: .

Как только RBM обучен, другой RBM «накладывается» поверх него, получая входные данные от последнего обученного слоя. Новый видимый слой инициализируется обучающим вектором, а значения единиц в уже обученных слоях назначаются с использованием текущих весов и смещений. Затем новый RBM обучается в соответствии с описанной выше процедурой. Весь этот процесс повторяется до тех пор, пока не будет достигнут желаемый критерий остановки.

Хотя приближение CD к максимальному правдоподобию является грубым (не следует за градиентом какой-либо функции), оно эмпирически эффективно.

Смотрите также

Рекомендации

внешняя ссылка

- «Сети глубокого убеждения» . Учебники по глубокому обучению .

- «Пример сети глубокого убеждения» . Deeplearning4j Учебники . Архивировано из оригинала на 2016-10-03 . Проверено 22 февраля 2015 .